Ein Problem, das ich auf fast jeder Website sehe, ist Duplicate Content. Größere Websites mit hunderten von Seiten sind in dieser Hinsicht besonders anfällig. Aber was versteht man genau unter Duplicate Content? Warum führt Duplicate Content zu Problemen und wie können wir sie vermeiden? Ich werde auf all das und mehr in diesem Beitrag eingehen.

Was ist Duplicate Content?

Duplicate Content liegt vor, wenn zwei oder mehr Inhalte identisch sind und der einzige Unterschied darin besteht, dass die URL anders ist.

Google sieht jede URL als eigene Seite. Aus diesem Grund würde sie die folgenden URLs als völlig unterschiedliche Seiten betrachten:

- Originalseite mit roten Hemden: http://website.com/hemden/rot

- Gleiche Seite, aber geordnet nach Preis: http://website.com/hemden/rot?order=asc

Das Problem dabei ist, dass wir im Grunde genommen die gleiche Seite mit dem gleichen Inhalt betrachten. Der einzige Unterschied besteht darin, dass der Inhalt der letzten URL in einer anderen Reihenfolge ist. Google betrachtet dies als Duplicate Content.

Warum ist Duplicate Content schädlich?

Duplicate Content verwirrt Suchmaschinen, weil es ihnen schwer fällt zu entscheiden, welche Seite für eine Suchanfrage am relevantesten ist.

Suchmaschinen werden niemals zwei identische Inhalte in den SERPs anzeigen. Dies geschieht, um die höchste Suchqualität zu gewährleisten. Die doppelte Anzeige desselben Inhalts ist für den Nutzer nicht interessant.

Ein weiteres Problem ist die Rangfolge der doppelten Seiten. Anstatt eine einzige Seite mit viel Authority zu haben, verfügen Sie über mehrere Webseiten mit schwammiger und suboptimaler Leistung. Das könnte Sie viel organischen Traffic kosten.

Wie Duplicate Content erzeugt wird.

Duplicate Content können absichtlich oder versehentlich erstellt werden. Dennoch ist das Ergebnis das gleiche.

Ein Beispiel für bewusst doppelte Inhalte ist die Druckversion einer Seite. Es ist praktisch die gleiche Seite mit dem gleichen Inhalt, also wenn diese Druckversion indiziert wird, gibt es ein Problem mit Duplicate Content.

Es gibt jedoch viele Situationen, in denen unbeabsichtigt doppelte Inhalte erstellt werden. Es kann mehrere Ursachen geben z.B:

- Session-ID

- Sortieroption

- Partner-Codes

- Domains.

- …

Session-Ids.

Eine Session-ID ist eine Variable, eine Folge von zufällig generierten Zahlen und/oder Buchstaben und wird verwendet, um Besucher zu tracken. Sie werden z.B. häufig für Shopping Carts verwendet:

http://webseite.com/?sessionid=5649612

Das Problem mit Session-IDs liegt auf der Hand: Sie können Hunderte, vielleicht sogar Tausende von Duplikaten erzeugen. Das Speichern von Session-IDs in Cookies kann dieses Problem lösen, aber wenn Sie sich auf diese Option verlassen, vergessen Sie nicht das EU-Cookie-Gesetz.

Sortieroptionen.

Wenn man über Sortiermöglichkeiten nachdenkt, grübelt man meistens an Webshop-Produktkataloge, in denen man nach Preis, Datum usw. sortieren kann. Aber auch auf anderen Websites gibt es häufig Sortierfunktionen. Die folgende URL verwendet eine typische Blog-Sortierfunktion:

http://webseite.com/kategorie?sort=asc

Die URL mit der Sortieroption und das Original sind im Prinzip die gleiche Seite. Es ist der gleiche Inhalt, nur anders sortiert.

Affiliate-Codes.

Affiliate-Codes tauchen überall im Internet auf. Sie werden verwendet, um den Referrer zu identifizieren, der wiederum für das Einbringen eines neuen Besuchers belohnt wird. Ein Affiliate-Code kann z.B. so aussehen:

http://webseite.com/product?ref=name

Wieder einmal kann dieser Code ein Duplikat der Originalseite erzeugen.

Domains.

Selbst etwas so Einfaches wie ein Domainname kann manchmal problematisch sein. Werfen Sie einen Blick auf die folgenden URLs:

http://website.com

https://webseite.com

Suchmaschinen haben sich sehr entwickelt, aber dennoch machen sie ab und an immer noch etwas falsch. Beide URLs zeigen wahrscheinlich auf die Homepage, aber da beide URLs unterschiedlich aussehen, werden sie manchmal als unterschiedliche Seiten gesehen.

So können Sie Duplicate Content identifizieren.

Wir haben darüber gesprochen, wie Duplicate Content erstellt wird, aber wie können Sie Duplicate Content auf ihrer Website identifizieren?

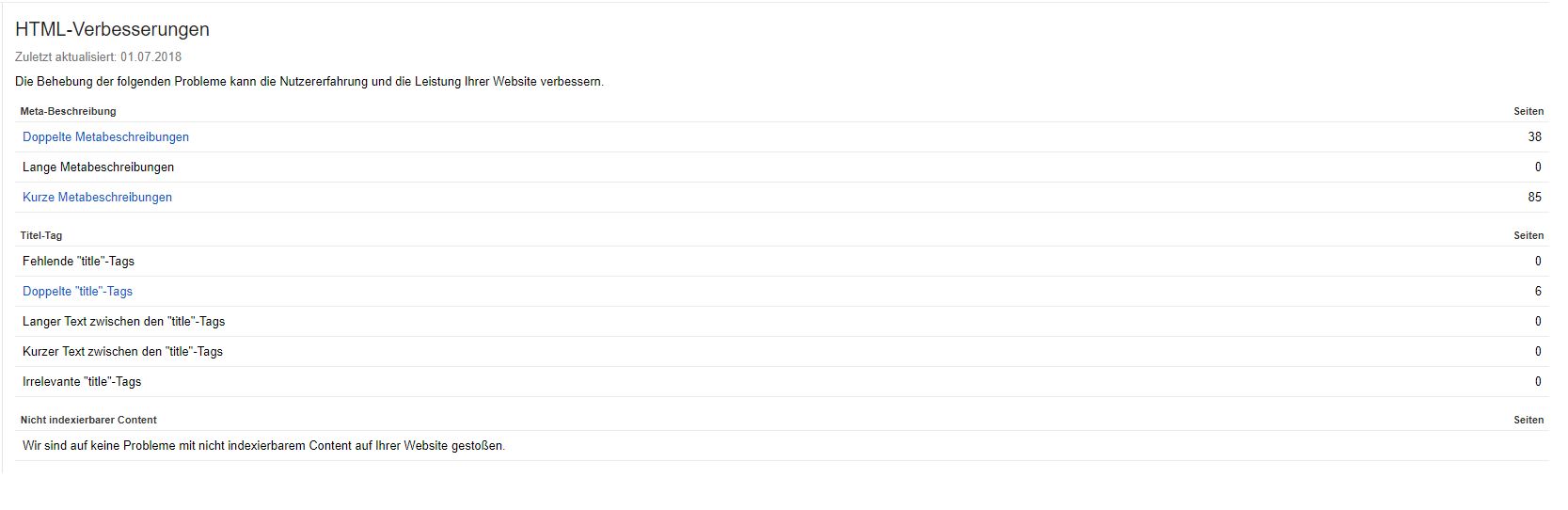

Am einfachsten geht das über die Google Search Console. Melden Sie sich in ihrem Account an und gehen Sie zu Darstellung in der Suche > HTML-Verbesserungen. Hier finden Sie eine Liste mit doppelten Titels.

Alternativ können Sie den Befehl site: search in der URL-Leiste eingeben, um Seiten einer bestimmten Domain zu finden. Diese Methode ist sehr nützlich, wenn Sie vermuten, dass eine bestimmte Seite mehrere Duplikate hat. Verwenden Sie den Website-Befehl und fügen Sie ein paar Sätze von der verdächtigen Seite ein. Wenn Sie eine Nachricht von Google erhalten: „Um ihnen die relevantesten Ergebnisse anzuzeigen, haben wir einige Einträge weggelassen…“, haben Sie wahrscheinlich Duplicate Content.

Schließlich können Sie auch Site Crawler verwenden. Software wie Xenu und Screaming Frog kann verwendet werden, um notwendige Informationen zu sammeln. Analysieren Sie die Seitentitel im Crawl-Report und prüfen Sie sie auf Dubletten.

Duplicate Content Probleme lösen.

Wie das Sprichwort schon sagt; „Für jede Krankheit existiert ein Heilmittel“. Glücklicherweise gibt es mehrere Möglichkeiten, Duplicate-Content-Probleme zu beheben:

Ein einfacher Weg, um zu verhindern, dass doppelte Inhalte indiziert werden, ist eine 301 Weiterleitung. Auf diese Weise werden den Benutzer und die Suchmaschinen vom Duplikat zum Original weitergeleitet. Als Ergebnis wird der gesamte Linkjuice auf die Originalseite gesendet.

Eine 301 Weiterleitung wird auf Apache-Servern implementiert, indem Regeln zur .htaccess-Datei ihres Servers hinzugefügt werden. Beachten Sie, dass diese Methode die Kopie „löscht“. Wenn Sie die Seiten mit doppelten Inhalten nicht loswerden wollen, sollten Sie die folgende Methode verwenden.

Rel=canonical

Es gibt mit canonical-Tags eine andere Möglichkeit, Suchmaschinen über doppelte Inhalte zu informieren. Dieser Code sollte im Header einer Webseite implementiert werden.

Nehmen wir den folgenden Fall an: Wir haben Seite B, das ein Duplikat von Seite A ist. Wenn wir Suchmaschinen darüber informieren wollen, würden wir den folgenden Code in das Markup von Seite B einfügen:

Dieser Code sagt aus, dass die aktuelle Seite tatsächlich eine Kopie der oben genannten URL ist. Nach der Implementierung werden die meisten Links auf die Originalseite übertragen und verbessern so die Ranking-Power dieser Seite. Im Gegensatz zur 301-Weiterleitung sind die doppelten Inhalte weiterhin zugänglich.

Meta-Robot-Tags.

Durch das Hinzufügen eines Meta-Robot-Tags mit dem Parameter „noindex“ können Sie verhindern, dass die doppelten Inhalte indiziert werden.

URL Rewriting.

Dies ist eine fortschrittlichere Lösung. Es ist schwieriger umzusetzen, wenn Sie ein begrenztes Verständnis vom Code haben, aber es kann bei einer Reihe von Gelegenheiten nützlich sein.Wie bereits erwähnt, kann der Domainname oft zu doppelten Inhaltsproblemen führen. Sie können dieses Problem lösen, indem Sie eine URL-Rewrite-Regel zu ihrer .htaccess-Datei hinzufügen. Wählen Sie ihre bevorzugte Domian und schreiben Sie URLs automatisch in die angegebene Domain um.

Ein weiteres Problem, über das wir gesprochen haben, ist die Verwendung von Session-Ids. Die gleiche URL mit einer anderen Session-ID kann als doppelter Inhalt angesehen werden. Auch hier kann die .htaccess-Datei verwendet werden, um diese Parameter zu deaktivieren.

Google Search Console.

Im vorherigen Abschnitt sprachen wir über automatisches URL Rewriting für Domainnamen. Ein einfacherer Weg, dies zu tun, ist über die Google Search Console. Loggen Sie sich einfach in ihr Konto ein, gehen Sie zur Konfiguration, klicken Sie auf Einstellungen und legen Sie eine bevorzugte Domain fest.

Wenn Sie dynamische URL-Parameter verwenden, können Sie Google mitteilen, wie diese zu behandeln sind. Auf diese Weise können Sie erkennen, welche Parameter ignoriert werden sollen. Dies kann oft viele Probleme mit doppelten Inhalten lösen. Besuchen Sie die Google Search Console und gehen Sie zu Konfiguration > URL-Parameter. Weitere Informationen finden Sie im Google-Support, aber verwenden Sie diese Funktion nur, wenn Sie wissen, wie die Parameter funktionieren, sonst können Sie versehentlich Seiten blockieren.

Language Targeting.

Dieses Problem bezieht sich auf Duplicate Content, aber es gibt einige Unterschiede.

Nehmen wir an, ein Unternehmen, das Produkte in Nordamerika verkauft, hat zwei Webseiten; betrieb.us und betrieb.ca. Die erste richtet sich an die USA, die zweite an Kanada. Auf beiden Seiten finden wir Inhalte, die ähnlich sind, weil die Webmaster nicht mehrere Seiten Text neu schreiben wollten.

Es ist möglich, dass die US- die kanadische Version übertrifft, weil sie mehr Authority hat. Wie können wir dieses Targeting-Problem beheben?

Es gibt eine einfache Lösung: die Anmerkung rel=“alternate“ hreflang=“x“.

Wenn wir unser vorheriges Beispiel verwenden, müssen wir den folgenden Code in die Header-Sektion der .us-Domain hinzufügen:

Auf der .ca-Domain müssen wir diesen Code platzieren:

Im Wesentlichen teilen Sie Google mit, dass es eine alternative Version in einer anderen Sparche gibt. Das hreflang-Attribut verwendet ISO 639-1, um die Sprache zu identifizieren. Optional können Sie die Region im ISO 3166-1 Format hinzufügen.

Schlussbemerkungen.Prävention ist alles… Durch konsequente interne Verlinkung kann die Erstellung doppelter Inhalte verhindert werden. Wenn Sie http://website.com als bevorzugte Domain haben, zeigen Sie ihre internen Links nicht auf die Nicht-www-Version. Der gleiche Tipp gilt für Backlinks. Wenn Sie von einer anderen Domain auf ihre eigene Seite verlinken, verwenden Sie eine konsistente Linkstruktur.

Erstellen Sie nicht absichtlich Duplicate Content, indem Sie große Textstücke von anderen Webseiten kopieren. Google wird es wahrscheinlich bemerken und die Folgen könnten nicht so angenehm sein:

„In den seltenen Fällen, in denen Google feststellt, dass doppelte Inhalte mit der Absicht angezeigt werden, um das Ranking zu manipulieren und Nutzer zu täuschen … kann das Ranking der Webseite leiden oder die Webseite kann vollständig aus dem Google-Index entfernt werden.“

Fazit.

Duplicate Content ist etwas, das Sie fast auf jeder Website sehen. Es kann mehrere Ursachen haben, die so beabsichtigt sind oder eben nicht.

Es sei denn, Sie wollen den Zugriff von der Seite über eine 301-Umleitung verhindern, verwenden Sie am besten die rel=canonical Annotation. Alternativ können Sie den Meta-Robot-Tag oder das automatische URL-Rewriting verwenden. Die Google Search Console bietet auch einige Möglichkeiten, um Duplicate Content zu verhindern.

Schließlich ist es am besten, bei der Verlinkung konsistent zu sein. Interne und eingehende Links sollten gleich au

Hinterlasse einen Kommentar

Du musst angemeldet sein, um einen Kommentar schreiben zu können.